Introducción

¿Crees que es un derecho tener un trabajo significativo como el de conductor de taxi a pesar de que los coches sin conductor son más seguros que los coches conducidos por humanos? ¿Qué pasa con el médico que diagnostica cáncer? ¿Debería tener ese derecho también, aunque el aprendizaje automático puede hacer un mejor trabajo?

Objetivos de aprendizaje para el capítuloAl final del capítulo, los participantes podrán:- reflexionar sobre los requisitos para que los sistemas de IA sean éticos

- evaluar sus propios valores

- tomar decisiones y formular argumentos relevantes para esto.

Diagrama de temas

Agencia humana y supervisión

El principio de respeto por la autonomía humana dice que los sistemas de IA deben ayudar a las personas a tomar sus propias decisiones y poder tomar sus propias decisiones. Esto requiere que los sistemas de IA actúen como facilitadores de una sociedad democrática, próspera y justa al apoyar la agencia del usuario que fomenta los derechos fundamentales y permitir la supervisión humana.

Los sistemas de IA, como muchas otras tecnologías, pueden tanto ayudar como perjudicar los derechos básicos de las personas . Pueden ayudar a las personas, por ejemplo, facilitándoles el seguimiento de sus propios datos o haciendo que la educación sea más accesible, lo que respalda su derecho a la educación.

También puede ser malo para los derechos fundamentales porque los sistemas de IA son muy grandes y poderosos. En situaciones en las que existan amenazas a los derechos fundamentales, se debe realizar una evaluación de impacto. Esta debe realizarse antes de la construcción del sistema y debe identificar si los riesgos pueden reducirse o justificarse en una sociedad democrática para que no se vulneren los derechos y libertades de las personas. Además, debería haber formas de obtener comentarios de personas que no trabajan con sistemas de inteligencia artificial para garantizar que los derechos básicos de las personas estén protegidos.

Los usuarios deben poder tomar decisiones autónomas informadas con respecto a los sistemas de IA. Se les debe proporcionar el conocimiento y las herramientas para comprender e interactuar con los sistemas de IA en un grado satisfactorio y, cuando sea posible, se les debe permitir autoevaluar razonablemente o desafiar el sistema. Los sistemas de IA deben ayudar a las personas a tomar decisiones mejores y más informadas de acuerdo con sus objetivos. Los sistemas de IA a veces se pueden implementar para dar forma e influir en el comportamiento humano a través de mecanismos que pueden ser difíciles de detectar. Pueden aprovechar los procesos subconscientes, incluidas varias formas de manipulación injusta, engaño, pastoreo y condicionamiento, todo lo cual puede amenazar la autonomía individual. El principio general de la autonomía del usuario debe ser fundamental para la funcionalidad del sistema. Para ello es clave el derecho a no ser objeto de una decisión basada únicamente en el tratamiento automatizado cuando tenga implicaciones jurídicas para los usuarios o les afecte significativamente de modo similar.

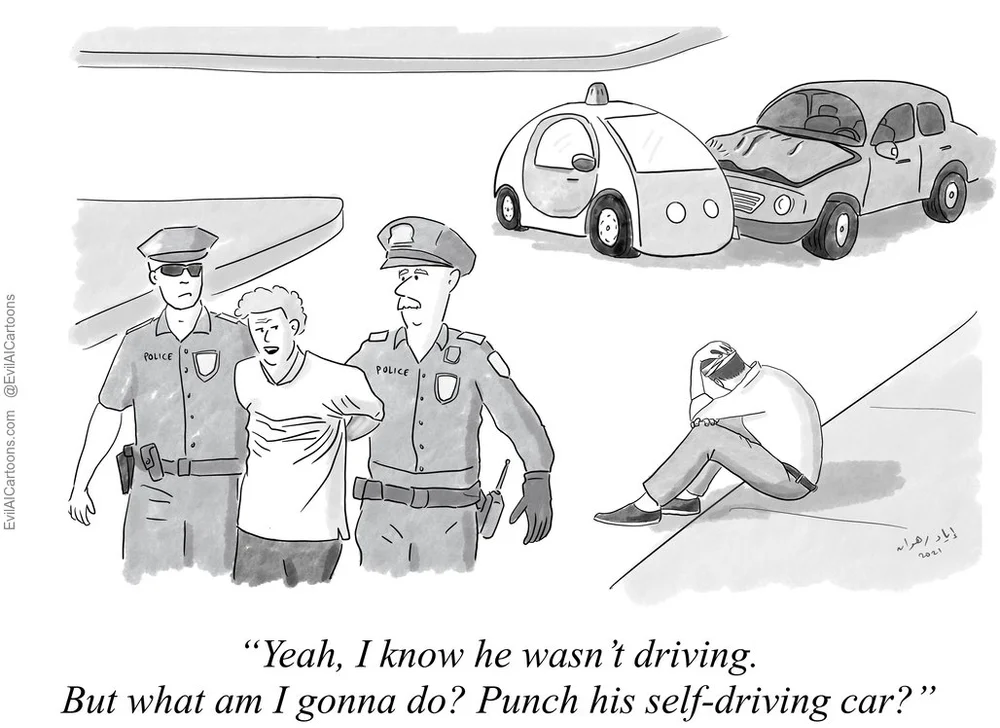

https://www.evilaicartoons.com/archive/do-not-use-humans-as-scapegoats

Los seres humanos están a cargo de todo lo que sucede. La supervisión humana ayuda a garantizar que un sistema de IA no quite la autonomía de las personas ni haga nada malo. Se pueden utilizar métodos de gobernanza Human-in-the-loop (HITL), Human -on-the-loop (HOTL) o Human -in-command (HIC) para supervisar y monitorear tales ocurrencias.

HITL se refiere a cuando no es posible o deseable que los humanos participen en todas las decisiones que toma el sistema.

HOTL se refiere a la capacidad de los humanos para participar en el diseño del sistema y monitorear cómo funciona el sistema.

HIC es la capacidad de supervisar los mayores efectos económicos, sociales, legales y éticos del sistema de IA, así como la capacidad de decidir cuándo y cómo usar el sistema en una situación determinada.En ciertas situaciones, puede ser mejor no usar un sistema de IA o establecer límites sobre cómo los humanos pueden usar el sistema. De manera similar, puede ser apropiado asegurar que los humanos puedan anular la decisión de un sistema.

Además, es necesario garantizar que los agentes públicos puedan desempeñar sus funciones de acuerdo con su mandato . Según el uso del sistema de IA y el nivel de riesgo, se requieren mecanismos de supervisión de diversas formas para respaldar otras medidas de seguridad y control. En igualdad de condiciones, cuanto menos control tenga un ser humano sobre un sistema de IA, más pruebas y reglas más estrictas se deben implementar.

Bienestar social y ambiental

Siguiendo los principios de equidad y prevención de daños, la comunidad en general y todos los demás seres vivos también deben considerarse partes interesadas clave en el ciclo de vida del sistema de IA. Se debe alentar a los sistemas de IA a que sean responsables con el medio ambiente y la sostenibilidad, y se debe alentar la investigación de soluciones de IA que ayuden a resolver problemas en todo el mundo, como los Objetivos de Desarrollo Sostenible de la ONU. Idealmente, los sistemas de IA deberían usarse para ayudar a todos los humanos, incluso a las generaciones futuras.

Los sistemas de IA pueden ayudar a resolver algunos de los problemas más importantes de la sociedad, pero deben usarse de la manera más respetuosa posible con el medio ambiente. El desarrollo, la implementación y el uso del sistema, así como toda su cadena de suministro, deben considerarse de esta manera. Se utilizan recursos y energía considerables durante cualquier actividad operativa dentro de una organización y las opciones menos dañinas deben ser un tema de atención. Como tal, se deben alentar activamente las medidas que hacen que los sistemas de IA y sus cadenas de suministro asociadas sean más amigables con el medio ambiente.

https://www.youtube.com/watch?embed=no&v=mvUPj2WbuKc

Los sistemas de inteligencia artificial social pueden cambiar la forma en que pensamos sobre la agencia social, o cómo pensamos sobre nuestras relaciones sociales y apegos, si estamos constantemente expuestos a ellos en todas las áreas de nuestras vidas. Los sistemas de IA pueden ayudar a las personas a mejorar sus habilidades sociales, pero también pueden empeorarlas y esto podría tener un impacto negativo en la salud física y mental de las personas. Por lo tanto, los efectos de estos sistemas deben ser monitoreados y examinados cuidadosamente.

https://www.youtube.com/watch?embed=no&v=LmNUtG6KxJM

También es importante pensar en cómo la IA afectará a las instituciones, la democracia y la sociedad en su conjunto. Los sistemas de IA deben deliberarse cuidadosamente cuando se usan en situaciones que involucran el proceso democrático, como cuando los políticos toman decisiones y cuando la gente vota.

La solidez técnica es una parte importante de la creación de un sistema de IA que sea confiable. Esto está estrechamente relacionado con el principio de prevención del daño. Esto significa que los sistemas de IA deben construirse con un enfoque proactivo de los riesgos y de una manera que garantice que hacen lo que se supone que deben hacer mientras minimizan los daños no intencionales e inesperados y evitan daños inaceptables. También se tendrán en cuenta los cambios en su entorno operativo, así como la presencia de otros agentes (humanos y artificiales) que puedan interactuar con el sistema de forma hostil. Además, se debe considerar el bienestar físico y mental de los humanos.

En la década de 1940, el autor de ciencia ficción Isaac Asimov escribió sus Tres leyes de la robótica :

- Un robot no puede dañar a un ser humano o, por inacción, permitir que un ser humano sufra daño.

- Un robot debe obedecer las órdenes que le dan los seres humanos, excepto cuando dichas órdenes entren en conflicto con la Primera Ley.

- Un robot debe proteger su propia existencia siempre que dicha protección no entre en conflicto con la Primera o la Segunda Ley.

La resistencia a los ataques y la seguridad es una consideración importante. Como todos los sistemas de software, los sistemas de IA deben protegerse de fallas que los piratas informáticos pueden explotar. Los piratas informáticos pueden intentar acceder a los datos ( envenenamiento de datos) en el modelo ( fuga de modelo) o en la infraestructura , que incluye software y hardware.

Los datos y el comportamiento de un sistema de IA pueden cambiar si es atacado, por ejemplo, en ataques adversarios . Esto puede hacer que el sistema tome decisiones diferentes, o puede apagarlo por completo.

Los sistemas y los datos también pueden ser dañados o corrompidos por humanos que quieren dañarlos o al exponer el hardware a entidades que son peligrosas. Los procedimientos de seguridad insuficientes pueden conducir a malas decisiones o incluso a daños físicos. Para que los sistemas de IA se consideren seguros, los tomadores de decisiones humanos deben considerar posibles usos no deseados del sistema de IA (por ejemplo , aplicaciones de doble uso ) y cómo el sistema podría ser utilizado por personas con malas intenciones. Se deben tomar medidas para prevenir y mitigar estos riesgos.

https://www.youtube.com/watch?embed=no&v=BNwWRwJ7XSA&t=15

Debería haber un plan alternativo disponible si algo sale mal con un sistema de IA. Las acciones pueden incluir cambiar el sistema de un procedimiento estadístico a uno que sigue reglas, o puede solicitar la intervención de un operador humano antes de continuar con su trabajo. Es crucial que el sistema haga lo que está diseñado y destinado a hacer sin dañar a los seres vivos o al mundo que los rodea. Esto incluye asegurarse de que no haya consecuencias o errores no deseados.

Además, se deben crear procesos para ayudar a las personas a comprender y evaluar los riesgos de usar sistemas de IA en una amplia gama de aplicaciones. El nivel de medidas de seguridad que se necesitan está determinado por el nivel de riesgo que plantea un sistema de IA y qué tan bien puede hacer su trabajo. Cuando se puede prever que el proceso de desarrollo o el sistema en sí tiene múltiples riesgos, es importante desarrollar y probar medidas de seguridad desde el principio.

La precisión se refiere a la capacidad de un sistema de IA para tomar las decisiones correctas , por ejemplo, al clasificar correctamente la información en los grupos relevantes, o al hacer las predicciones, recomendaciones o evaluaciones apropiadas basadas en datos o modelos. Un proceso de desarrollo y evaluación explícito y bien formado puede ayudar a mitigar y corregir los riesgos. Cuando el sistema no puede evitar hacer algunas predicciones incorrectas, es importante que pueda mostrar la probabilidad de que ocurran estos errores. En situaciones en las que el sistema de IA tiene un impacto en la vida de las personas, un alto nivel de precisión es especialmente importante.

Para que los sistemas de IA funcionen bien, deben poder producir los mismos resultados una y otra vez. Un sistema de IA confiable debería poder manejar muchos tipos diferentes de entradas y situaciones. La reproducibilidad se refiere a si un experimento de IA se comporta de la misma manera cuando se realiza nuevamente en las mismas circunstancias. Los archivos de replicación pueden facilitar la prueba y la reproducción del comportamiento cuando se utiliza el sistema.

Privacidad y gobierno de datos

La privacidad está íntimamente ligada a la idea de prevenir daños y es un derecho fundamental sobre el que pueden impactar los sistemas de IA. La calidad y la integridad de los datos, la relevancia de los datos para el dominio donde se utilizarán los sistemas de IA, los protocolos de acceso y cómo se procesarán los datos son importantes para garantizar la privacidad.

Los sistemas de IA deben proteger la privacidad y los datos de las personas durante todo el ciclo de vida de un sistema y esto se denomina "gobernanza ". Cuando una persona interactúa con un sistema de IA, se crea información sobre ellos con el tiempo. Esto incluye la información proporcionada por ellos cuando comienzan a usar el sistema por primera vez, así como la información que el sistema de IA crea sobre ellos a medida que interactúan con él. Los sistemas de inteligencia artificial pueden determinar no solo lo que le gusta o disfruta a un individuo, sino también su orientación sexual, edad, género, opiniones religiosas o políticas, en función de los registros digitales de su comportamiento. Debido a que las personas deben poder confiar en el proceso de recopilación de datos, se debe garantizar que la información que se recopila sobre ellas no se utilizará para discriminarlas de ninguna manera.

https://www.youtube.com/watch?embed=no&v=1bhpWEMZ6XA

La calidad de los datos utilizados en los sistemas de IA es fundamental para su buen funcionamiento. Cuando se recopilan datos, pueden tener sesgos, inexactitudes, errores y equivocaciones creados socialmente que cometen las personas. Esto requiere atención antes de que se pueda utilizar cualquier conjunto de datos. Además, los datos deben ser revisados para asegurarse de que son correctos. La alimentación de datos maliciosos o datos que no se "limpian" en un sistema de IA puede hacer que actúe de manera diferente, especialmente si el sistema es de autoaprendizaje.

Debe haber muchas pruebas y documentación en cada paso, desde la planificación hasta la capacitación, las pruebas y la implementación. Esto también debería aplicarse a los sistemas de IA que no se construyeron internamente sino que se compraron a un tercero.

Ya sea que alguien sea un usuario del sistema o no, debe haber reglas sobre cómo las personas pueden acceder a sus propios datos. Estos protocolos deben indicar claramente quién puede ver los datos y cuándo. Solo las personas que necesitan ver los datos de una persona deberían poder hacerlo. Este requisito está íntimamente ligado a la idea de transparencia e incluye los datos, el sistema y los modelos de negocio que componen un sistema de IA.

Transparencia

La transparencia, en términos generales, es la cualidad de ser fácilmente visible. En términos de IA, incluye hacer que los datos, el sistema y los modelos comerciales asociados con el sistema sean claros para todos.

Las decisiones del sistema de IA deben documentarse de la mejor manera posible, incluidos los conjuntos de datos y los procesos que dieron lugar a ellas, y los algoritmos que se utilizaron. Esto hace que sea más fácil para las personas ver cómo el sistema de IA tomó sus decisiones y llegó a sus conclusiones, lo que lo hace transparente. Cuando una decisión de IA es incorrecta, también ayuda a determinar por qué y ayuda a evitar volver a cometer el mismo error. Del mismo modo, la trazabilidad facilita la auditoría y la explicación.

La explicabilidad es la capacidad de explicar tanto los procesos técnicos de un sistema de IA como las decisiones humanas que los acompañan (por ejemplo, las áreas de aplicación de un sistema). Los sistemas de IA deben poder tomar decisiones que los humanos puedan explicar y rastrear. También puede haber compensaciones entre hacer que un sistema sea más explicable (lo que puede hacerlo menos preciso) y hacerlo más preciso (lo que puede hacerlo menos explicable).

Cuando un sistema de IA tiene un gran impacto en la vida de las personas, estas tienen derecho a obtener una explicación aceptable de cómo el sistema de IA tomó sus decisiones. Dicha explicación debe ser oportuna y adaptada al nivel de conocimiento del individuo (p. ej., profano, usuario o regulador).

Además, deben estar disponibles las explicaciones de cómo un sistema de IA afecta y da forma a la forma en que una organización toma decisiones, cómo se creó el sistema y por qué se utilizó, lo que garantiza la transparencia del modelo de negocio.

https://www.youtube.com/watch?embed=no&v=3wLqsRLvV-c&t=6

Los sistemas de IA no deben hacer que los usuarios piensen que son humanos. Las personas tienen derecho a saber que están interactuando con un sistema de IA . Esto significa que los sistemas de IA deben poder reconocerse como tales. Además, las personas deberían poder optar por no tener esta interacción en favor de la interacción humana cuando sea necesario para proteger sus derechos básicos.

Aparte de eso, las habilidades y limitaciones del sistema de IA deben comunicarse a los profesionales de la IA o a los usuarios finales de una manera que se ajuste al propósito del escenario. Esto podría incluir informar a las personas sobre la precisión del sistema de IA, así como sobre lo que no puede hacer.

Diversidad y no discriminación

Para hacer que la IA sea confiable, es necesario garantizar que todos tengan la oportunidad de ser parte del ciclo de vida del sistema de IA . Esto también significa que todas las personas afectadas por el proyecto deben ser consideradas e involucradas en el proceso. Además, todos los involucrados deben tener igual acceso al proyecto y ser tratados de la misma manera. Esta regla está íntimamente ligada a la idea de equidad .

Es posible que los datos utilizados por los sistemas de IA (tanto para capacitación como cuando están operativos) puedan tener un sesgo histórico , estar incompletos o estar sujetos a una mala gobernanza . Podría haber prejuicios no deseados (indirectos), discriminación y marginación de ciertos grupos de personas si estos sesgos permanecen dentro del conjunto de datos.

Los sesgos del consumidor también se pueden usar para dañar a las personas intencionalmente. La competencia desleal, como la colusión y un mercado no transparente, son ejemplos clave. Es importante eliminar cualquier sesgo discriminatorio o identificable cuando sea posible durante la fase de recopilación, si es posible hacerlo. Para evitar esto, debe haber procesos de supervisión que analicen el propósito, las limitaciones, los requisitos y las decisiones del sistema de manera clara y abierta. Además, la contratación de personas de diferentes orígenes, culturas y campos puede ayudar a filtrar los sesgos, y esto debe alentarse activamente.

https://www.youtube.com/watch?embed=no&v=59bMh59JQDo

Los usuarios deben ser el centro de atención de los sistemas en entornos de empresa a consumidor, y deben diseñarse de manera que todos puedan usar los productos o servicios de IA . Por ejemplo, las personas con discapacidad deben ser atendidas para que puedan usar la tecnología de manera efectiva. Los sistemas de IA no deben tener un enfoque único para todos y deben aplicarse principios de diseño universal para llegar a la gama más amplia posible de usuarios. Se deben cumplir las reglas relacionadas con la accesibilidad y se debe usar tecnología de asistencia para que todos puedan participar en actividades humanas mediadas por computadora.

Para construir sistemas de IA que sean confiables, es importante consultar con las personas que se verán afectadas por el sistema de alguna manera. Es beneficioso, si no esencial, obtener comentarios de las personas incluso después de que se hayan implementado los sistemas de IA, y establecer formas a largo plazo para que las personas participen. Esto se puede hacer, por ejemplo, otorgando a los usuarios roles consultivos en relación con el proceso de implementación de la IA.

Responsabilidad

Además de otros requisitos éticos, la rendición de cuentas es igualmente muy pertinente y está vinculada a la idea de equidad . Es importante que existan métodos para confirmar que los sistemas de IA y sus resultados están sujetos a rendición de cuentas y responsabilidad tanto antes como después de que se construyan, implementen y utilicen.

https://www.evilaicartoons.com/archive/terminology-black-box

La auditabilidad se refiere a poder verificar algoritmos, datos y procesos de diseño, sin embargo, esto no significa que la información sobre los modelos comerciales y la propiedad intelectual del sistema de IA siempre deba hacerse pública. Los auditores internos y externos, así como la disponibilidad de sus informes de evaluación, pueden ayudar a asegurar la confiabilidad de la tecnología. Cuando las aplicaciones afecten los derechos básicos, como en escenarios críticos para la seguridad, los sistemas de IA deben estar sujetos a controles apropiados y relevantes, y cualquier sistema debe poder informar decisiones o acciones que conduzcan a un determinado resultado del sistema, así como lo que sucede. como resultado.

Los sistemas de IA pueden tener consecuencias negativas para las personas que no se ven directamente afectadas por ellos, por lo que es importante encontrar, evaluar, documentar y tratar de minimizar tales sucesos. Por ejemplo, los denunciantes, las ONG y los sindicatos deberían poder obtener la protección que necesitan cuando denuncian problemas con un sistema de IA. Los impactos negativos se vuelven evidentes si los sistemas de IA no se planifican y utilizan de manera adecuada, por lo que las evaluaciones de impacto (como el equipo rojo u otros tipos de evaluación de impacto algorítmico) pueden ayudar a eliminar o minimizar esto. Para que estas evaluaciones sean justas, deben basarse en cuánto riesgo representan los sistemas de IA para las personas.

Un equipo rojo o equipo rojo es un grupo que juega el papel de un enemigo o competidor para brindar retroalimentación de seguridad desde esa perspectiva. Los equipos rojos se utilizan en muchos campos, especialmente en la ciberseguridad, la seguridad aeroportuaria, el ejército y las agencias de inteligencia.

Al formular los requisitos anteriores, puede haber preocupaciones en conflicto, lo que puede conducir a compensaciones como punto medio. Tales compensaciones deben abordarse de manera racional y metódica y el sistema de IA debe ser capaz de identificar los intereses y valores que pueden afectar. En tales casos, las compensaciones deben reconocerse y evaluarse explícitamente en términos de su riesgo para los principios éticos, incluidos los derechos básicos. Debe haber una justificación válida para cualquier decisión que se tome sobre qué compensación hacer, y la persona que toma la decisión debe aceptar la responsabilidad de tomarla. La responsabilidad también recae en ellos para garantizar que el sistema se pueda cambiar si es necesario.

Lecturas adicionales

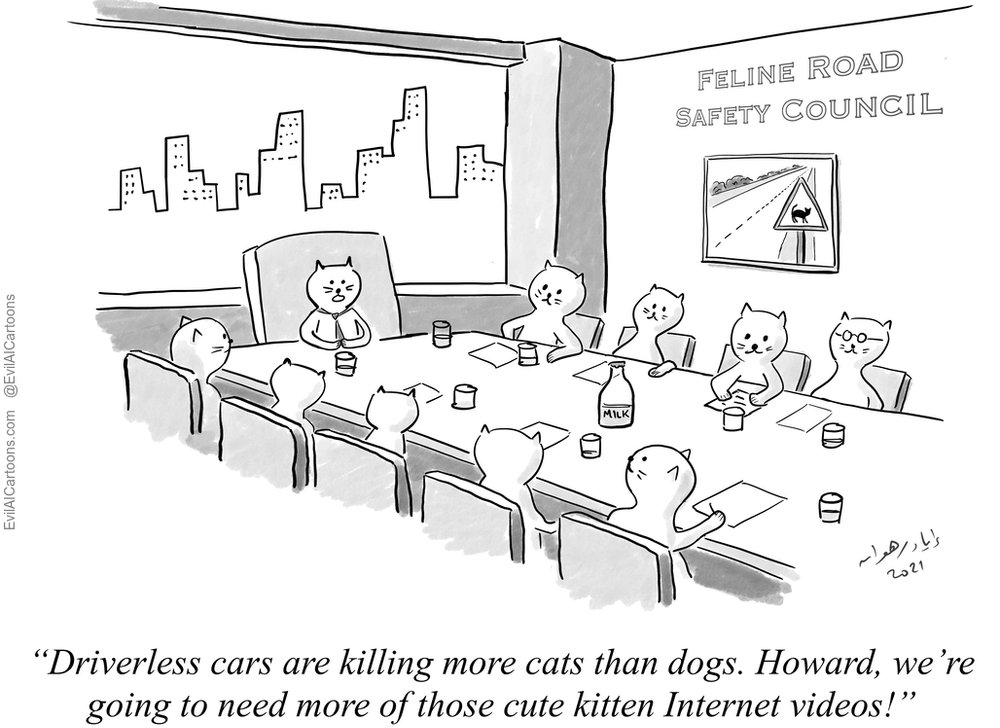

EvilAIDibujos animados

EvilAICartoons " tiene como objetivo educar y estimular la discusión sobre los impactos sociales de la inteligencia artificial a través del medio de dibujos animados/cómics. Cada dibujo animado está acompañado por una breve publicación de blog que brinda más contexto e indicadores útiles para leer más. Al comprender mejor los riesgos de la IA, podemos reducir nuestra ansiedad sobre la tecnología y aprovechar todos los beneficios que ofrece a la humanidad".

Enciclopedia de Filosofía de Stanford

Este contiene un artículo titulado " Ética de la Inteligencia Artificial y la Robótica ". Discute cómo " La inteligencia artificial (IA) y la robótica son tecnologías digitales que tendrán un impacto significativo en el desarrollo de la humanidad en un futuro cercano. Han planteado preguntas fundamentales sobre qué debemos hacer con estos sistemas, qué deben hacer los sistemas mismos, qué riesgos implican, y cómo podemos controlarlos”.

MoralMachine

" Le mostramos dilemas morales, donde un automóvil sin conductor debe elegir el menor de dos males, como matar a dos pasajeros o cinco peatones. Como observador externo, usted juzga qué resultado cree que es más aceptable. Luego puede ver cómo sus respuestas comparar con los de otras personas.

Si se siente creativo, también puede diseñar sus propios escenarios, para que usted y otros usuarios exploren, compartan y discutan "

Recomendaciones de principios en materia de inteligencia artificial.

Pautas de ética para una IA confiable

Estas directrices han sido desarrolladas por un grupo de expertos independientes encargados por la Comisión Europea.¿Por qué la ética es crucial en el desarrollo de la IA?